Maravillas del universo ver online

A todos nos gusta olisquear bien. Puede hacer que tu día sea perfecto. Hoy en día las olores son fundamentales en tanto que no solo combaten el fragancia anatómico, sino también ayudan a acrecentar la confianza. Olisquear el placer tiene otros beneficios asimismo, como la reducción del agobio y los efectos del insomnio. Prueba con maravillas del universo ver online, casa maravillas opiniones o bien agua de maravillas hermes y mejora tus experiencias. ¿Mas de qué manera sabes cuándo has encontrado la mejor colonia para ti? Reconocerás tu aroma propio cuando lo huelas. Es un poco como el amor: Escoge la que atraiga más cumplidos. Tú, y la gente que te rodea, deberían gozar del aroma. En tanto que compras un perfume, completa tus compras de olores consultando nuestras tiendas de belleza en línea preferidas a fin de que puedas refrescar tu colección de belleza.

Listado top ventas para Maravillas del universo ver online

En esta de productos vamos a mostrarte lo mejor en maravillas del universo ver online para el bienestar de tu salud. En este momento encontrarás lo mejor para tu bienestar, teniendo la oportunidad de comparar entre las mejores opciones del mercado.

Trust Auriculares para juegos Ziva Over-Ear con micrófono retráctil, negro / rojo

- Ideal para aplicaciones de juegos, música y chat en línea

- Diadema ajustable y orejeras suaves

- Micrófono retráctil sensible

- Tapa de control de volumen en la oreja

- Funciona con todas las PC y portátiles, cable de 1,8 m. No apto para teléfonos

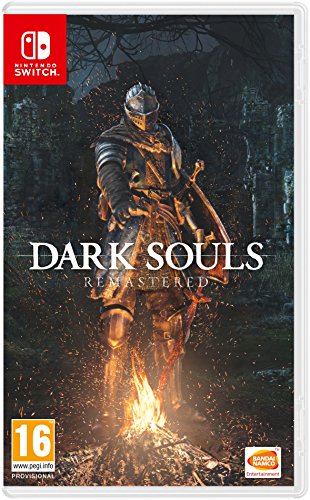

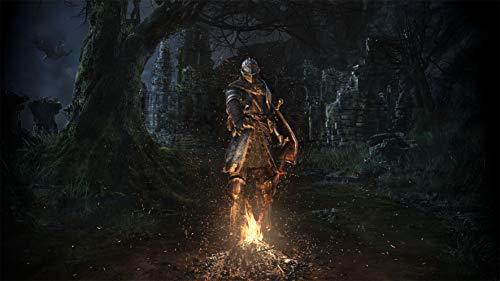

Dark Souls: Remastered - Edición Estándar

- Este producto incluye el juego principal y el contenido descargable "Artorias of the Abyss"

- Adéntrate en un épico y oscuro universo de fantasía asolado por la decadencia y la maldición. Explora el complejo diseño de su mundo, repleto de pasajes ocultos, mazmorras y secretos, y descubre su arraigado trasfondo

- Con el amiibo Solaire de Astora (a la venta por separado), podrás ejecutar el popular gesto "Alabar al sol"

- Cada partida te sorprenderá con nuevos desafíos y facetas nuevas del juego

- Descubre las múltiples combinaciones de armas, armaduras, magia y opciones de creación para diseñar tu propio estilo y experiencia de juego

- Mejora a tu personaje y desarrolla tus habilidades como jugador a medida que vas dominando el juego. Planea estrategias con total libertad y enfréntate a enemigos intimidantes

- Incluye modo multijugador online para hasta 6 jugadores (con servidores dedicados): juega con otros jugadores y busca lo que más te interesa según tu modo de juego, ya sean colaboraciones, enfrentamientos, alianzas o traiciones. Descubre tu hogar dentro de cualquiera de los 9 pactos

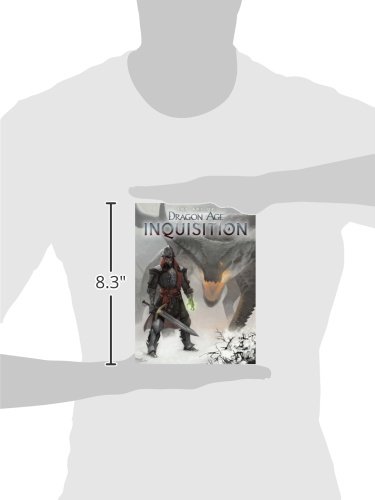

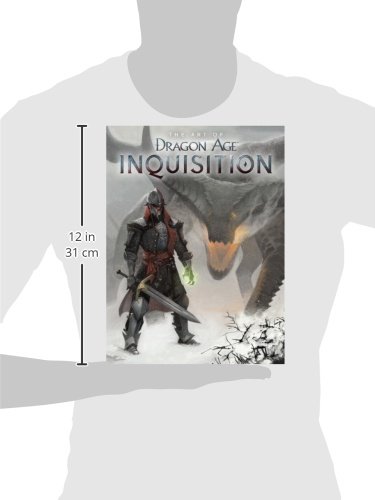

The Art of Dragon Age: Inquisition

![Maravillas Del Universo [Blu-ray] Maravillas Del Universo [Blu-ray]](https://www.iesribera.es/pics/2022/03/02/maravillas-del-universo-blu-ray-321467.jpg)

Maravillas Del Universo [Blu-ray]

- Precio mínimo ofrecido por este vendedor en los 30 días anteriores a la oferta: 13.27€

LA FUERZA DE LOS ABRAZOS

Spider-Man (2002)

Fallout 76 Amazon S.*.*.C.*.*.L. Edition (Edición Exclusiva Amazon)

- Este producto está disponible exclusivamente en Amazon

- Esta edición incluye los atributos de Fuerza, Carisma y Suerte. Completa tu colección comprando los cuatro atributos restantes en un set de pines por separado, también disponibles en Amazon.

- Además del esperadísimo juego, la S.*.*.C.*.*.L. Edition exclusiva de Amazon incluye un set de tres pines del rango de atributos S.*.*.C.*.*.L. de Fallout, el conjunto de reglas que impulsa todos los juegos de Fallout y el acrónimo para las estadísticas primarias del sistema: Fuerza (Strength), Percepción (Perception), Aguante (Endurance), Carisma (Charisma), Inteligencia (Intelligence), Agilidad (Agility) y Suerte (Luck)

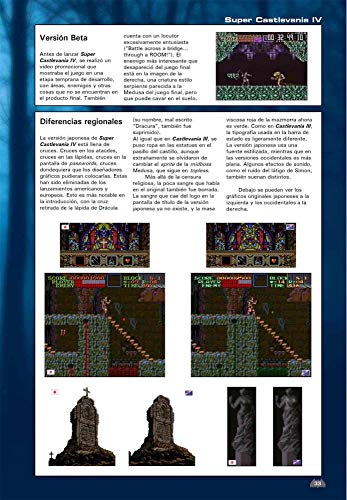

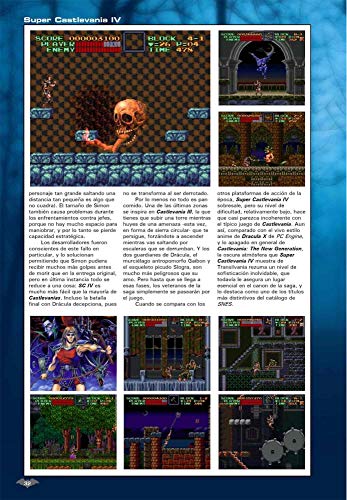

Hardcore Gaming 101 Presenta CASTLEVANIA

- Edición en CASTELLANO, tapa dura y sobrecubierta retro

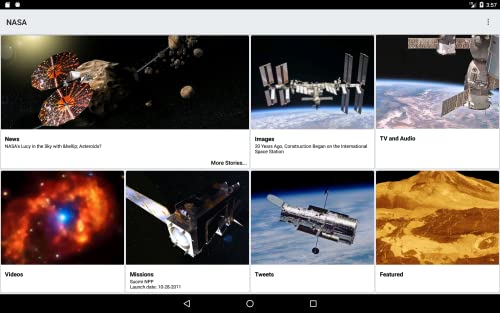

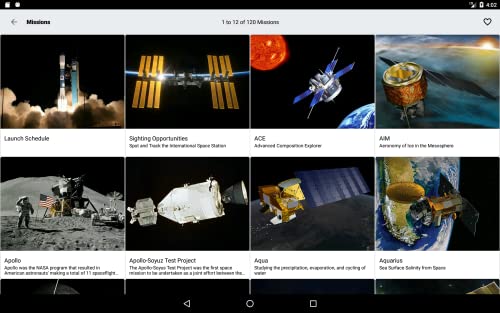

NASA

- Watch live-streaming NASA Television

- Get a real-time view of Earth from the International Space Station

- View more than 16,000 images, either individually or as a slideshow

- Play more than 14,000 on-demand NASA videos

- Learn more about NASA’s current missions

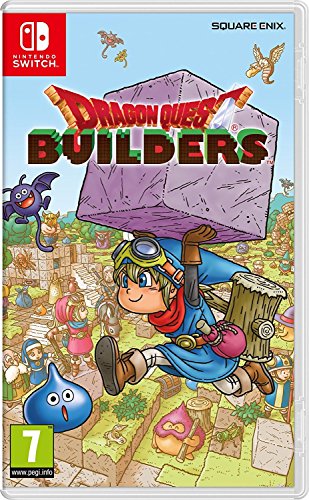

Dragon Quest Builders - Edición Estándar

- El malvado Draconarius ha sumido al reino Alefgrado en la más completa oscuridad

- La humanidad ha perdido la capacidad para construir y los habitantes de Alefgrado se han visto obligados a vagar por las ruinas de su antiguo hogar, buscando entre los escombros para sobrevivir

- Adéntrate en el papel de una figura legendaria, un héroe elegido por los dioses dispuesto a devolver el don de la creación a los habitantes de Alefgrado

- Embárcate en una aventura que combina elementos de crafting, rol y acción en un mundo abierto que podrás explorar libremente

- Conviértete en el mejor constructor y usa tu imaginación como arma para enfrentarte a los peligrosos monstruos que campan a sus anchas en este mundo de tipo sandbox

- Fabrica distintas herramientas con los materiales que reúnas, combate contra los monstruos más famosos de Dragon Quest y reconstruye pueblos y ciudades para que resurja la creatividad entre las ruinas de Alefgrado

- Con el modo de construcción libre podrás desconectar y centrarte en construir

South Park: Retaguardia En Peligro - Standard Edition

- Con las voces oficiales de la serie TV en español

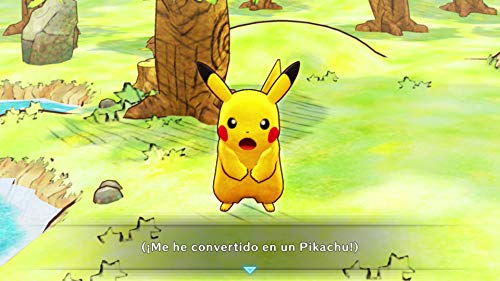

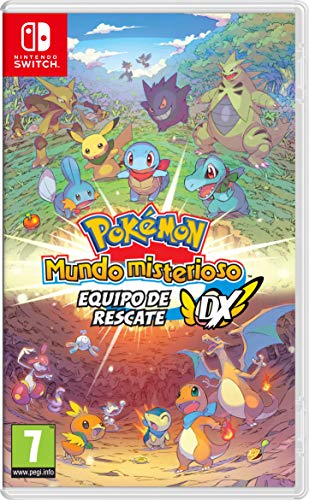

Pokemon Mundo Misterioso: Equipo de Rescate DX

- ¿Qué harías si un día te despertases con forma de Pokémon?

- Prepárate para explorar un precioso mundo reimaginado en Pokémon Mundo misterioso: equipo de rescate DX, una revisión de los juegos originales para Nintendo DS y Game Boy Advance. Partiendo de Pikachu, Eevee y Charmander, podrás crear un equipo de rescate con el que afrontar misiones para salvar a Pokémon en territorios generados aleatoriamente.

- Haz el cuestionario para descubrir en qué Pokémon te convertirás

- Encarnarás a un Pokémon y podrás relacionarte con otros hablando, entablando amistad o luchando junto a ellos

- Crea tu equipo de Pokémon y salva al mundo de desastres naturales

- Explora territorios misteriosos cuya estructura cambia cada vez que te adentras en ellos

- Lánzate a la aventura con tu equipo de rescate y podrás conocer a muchos tipos de Pokémon

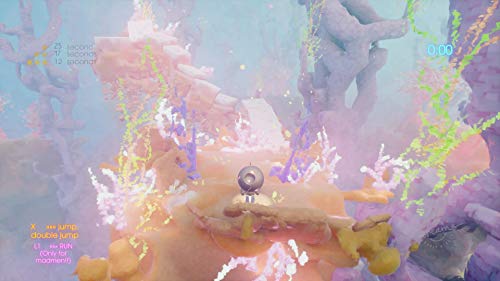

Dreams

- Es una experiencia ilimitada en la que puedes crear cualquier cosa, desde aventuras interactivas y juegos de plataformas hasta shoot ‘em ups, juegos de puzles y mucho más

- Cualquier cosa que crees podrás compartirla con una enorme comunidad online, donde también podrás examinar las creaciones de otros jugadores

- Explora la acción y aventura del modo historia de Dreams, donde podrás jugar tres emocionantes relatos en una deslumbrante exhibición de lo que pueden conseguir las potentes herramientas de creación del juego

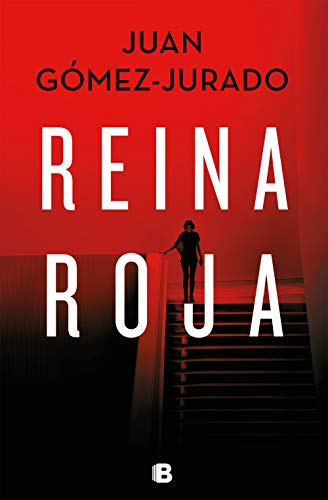

Reina roja

Imágenes de Maravillas del universo ver online

Aquí te mostramos una galería de fotografías de maravillas del universo ver online para que te formes una idea y puedas seleccionar entre todos los modelos de perfume. Pincha con el ratón en en una de las imágenes para ver la ficha entera del artículo y su valor.

![Maravillas Del Universo [Blu-ray] Maravillas Del Universo [Blu-ray]](https://www.iesribera.es/pics/2022/03/02/maravillas-del-universo-blu-ray-321467-2.jpg)